搜索引擎蜘蛛的爬取策略包括这几种

文章作者:seo优化大师 文章来源:港翔seo优化 搜索引擎蜘蛛的爬取策略包括 浏览量:

本文导读:SEO人都是非常关注网站收录量以及页面收录比的,从搜索引擎来看,收录与spider蜘蛛有着直接的关系。通过主动或者被动的方式,让程序更好的收录网站内容,是做网站seo的基础。

SEO人都是非常关注网站收录量以及页面收录比的,从搜索引擎来看,收录与spider蜘蛛有着直接的关系。通过主动或者被动的方式,让程序更好的收录网站内容,是做网站seo的基础。

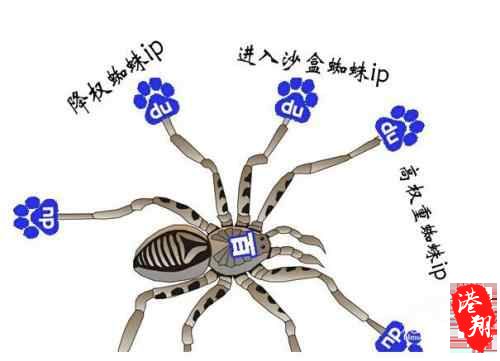

spider蜘蛛是什么抓取互联网中海量的链接呢?无外乎两个方法。

第一个方法是类似于扫描的方式,主动爬取链接。

第二个方法是seo人通过站长平台的链接提交工具,将自己网站的新内容链接页提交给搜索引擎。注:对于用户主动推送的链接,搜索引擎是有特别的喜好的。

很多站长会常常面临一个问题,那就是整站的内容长手机不被收录,或者被收录的量很少,或者被收录的页面占比很低,即使使用了链接提交等方法,依旧如此。对于收录问题,是有很多影响因素的,如内容质量度,站点质量,页面本身的质量等,其中与spider蜘蛛的关系颇大,本文就这个因素,做一些说明。希望seoer把这个方面把控好。

有哪些因素会造成spider蜘蛛无法正常爬取网站内容?

1:错误的robots协议设置。

网站的robots文件是搜索引擎看网站的第一个文件,这个文件的设置错误如禁止搜索引擎爬取会导致无法受理。WEB视界SEO支持以前就犯了类似的错误。

2:内容本身的质量度。

搜索引擎算法不断完善,对于大部分的低质量内容都可以进行识别,对于优质内容如时效性内容会优先进行质量评估,对于低质量内容如空洞内容,过度优化页面进行降分对待。这与百度一直提倡的优质内容遥相呼应。小明关于写作内容,有写作”百度判定网站优质内容的几个维度“,可仔细阅读。

3:spider蜘蛛无法正常抓取。

除开robots协议禁封以外,还存在别的方面导致蜘蛛无法爬取。典型的情况是网站打开速度慢,服务器不稳定或者宕机,这些情况就会导致收录问题。

4:seo容易忽略的网站抓取配额问题。

通常情况下,蜘蛛会根据网站的日常更新频率下发特定的抓取配额,这种情况下不会影响抓取收录问题,但有的时候网站被黑等情况,会导致网站的页面数量爆发式增长。一方面这些页面属于灰色页面,另外一方面,爆发的新页面会因为网站原先的抓取配额限制而导致网站造成的页面无法被爬取和收录。

影响网站收录的原因方方面面,采用排查法,从各种方面排查不正常收录的原因,才能提升网站的收录量与收录比。

注:索引库是分级的,内容收录后,进入优质索引库,产生排名的几率才会更高。这说明:网站收录并不是量大就好。

版权保护: 本文由 seo优化大师 转载于网络,版权归原作者所有,如有侵权请联系 seo优化大师 删除

转载请保留链接:[搜索引擎蜘蛛的爬取策略包括这几种] http://www.qqsn.com.cn/seo/373.html